Пользователь X/Twitter с ником pakhandrin провёл необычный тест новой омнимодели ChatGPT-4o (самого передового чат-бот от OpenAI на данный момент), попросив её распознать почерк предписаний врачей на русском языке. Всего тестов было пять, каждый с более высоким уровнем сложности.

Нейросеть полноценно справилась только с первым, но сделала это, пожалуй, лучше ожидаемого — распознала смайлики разных форматов и исправила ошибку в исходном тексте.

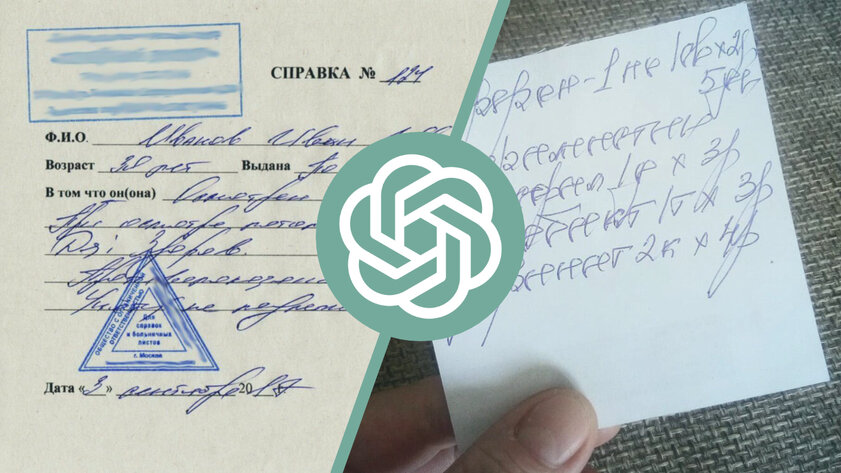

Во втором варианте ChatGPT-4o уже начал допускать ошибки — в частности, в номере справки и, возможно, в конечной фразе.

На третьем тесте нейросеть увидела список продуктов вместо перечисления лекарств. Когда ей явно указали, что на фото перечень медикаментов, она написала случайные наименования — видимо, ИИ-галлюцинация.

Четвёртый и пятый тесты больше похожи на приколы из интернета, чем на реальные заметки врачей (но это неточно). Результаты распознавания таких текстов ожидаемые.